Ads block

Sơ đồ nối đất

1. Sơ đồ TT: Trung tính-đất, vỏ kim loại-đất (vỏ kim loại nối thẳng xuống đất): nó thích hợp cho lưới có sự kiểm tra hạn chế or lưới có thể mở rộng hoặ…

Đọc thêm »

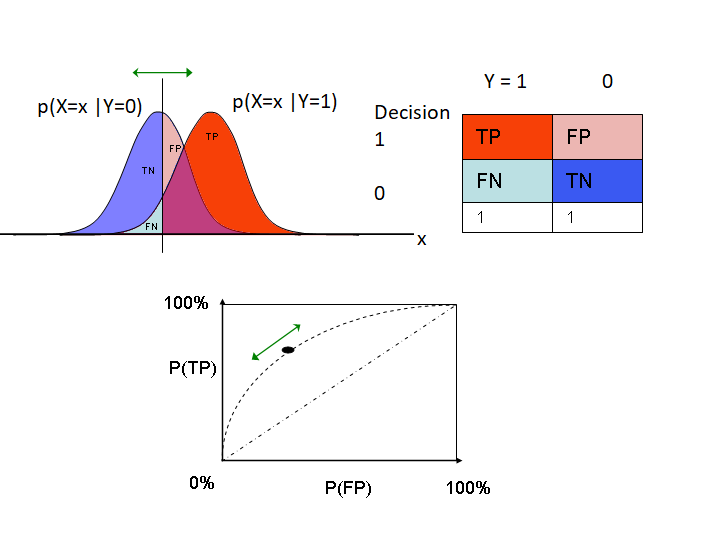

Đường cong ROC - receiver operating characteristic

Trong lý thuyết phát hiện tín hiệu , một receiver operating characteristic ( ROC ), còn gọi là receiver operating curve (đường cong đặc trưng hoạt động c…

Đọc thêm »

Tổng quan về Mạng Neuron (Neural Network)

By

Admin

Documents

·

Mạng Neural

Mạng Neuron nhân tạo (Artificial Neural Network- ANN) là mô hình xử lý thông tin được mô phỏng dựa trên hoạt động của hệ thống thần kinh của sinh vật, bao gồ…

Đọc thêm »

SEARCH

LATEST

3-latest-65px

SECCIONS

- AutoCAD (21)

- Báo chí - Xã hội (6)

- Các Tiêu Chuẩn (11)

- Cáp - Dây dẫn điện (7)

- Chữ trong AutoCAD (1)

- Clip hay (4)

- DIY (2)

- Documents (15)

- Điện (2)

- Điện Tử (3)

- Electrical (1)

- Giáo Trình (4)

- giới thiệu (1)

- HDSD Office (1)

- HDSD Thiết bị (3)

- Hệ thống chống sét (1)

- Hệ thống nối đất (1)

- Học Anh Văn (2)

- Library (1)

- Linh tinh (1)

- Lớp C14D (1)

- Mạng Neural (2)

- Matlab (1)

- Máy Điện (2)

- MS Word (3)

- Năng Lượng Mới (1)

- Office (1)

- PowerWorld (2)

- Sản xuất máy móc -thiết bị (2)

- Softwares (11)

- Suy Ngẫm (1)

- Sư phạm bậc 2 (4)

- Sức khoẻ (1)

- Thao tác vận hành (10)

- Thiết Bị Bảo Vệ (9)

- Thiết bị chuyển đổi (1)

- Thiết bị đo lường (3)

- Thiết Bị Đóng Cắt (7)

- Thiết bị lưu trữ điện (1)

- Tiêu chuẩn ngành Điện (9)

- Tính toán sửa chữa máy điện (1)

- Tổng quan (3)

- Trạm Biến Áp (1)

- Tủ điện (2)

- Vẽ Điện (21)

- Video (3)

- Video HDSD thiết bị (1)

- Xy lanh - Khí nén (1)

Được tạo bởi Blogger.

Tìm kiếm Blog này

BTemplates.com

BTemplates.com

About

Blogroll

Top Links Menu

Sidebar location, Sticky menu and more.

Menu based on Icons

Theo dõi

Section Background

Background image. Ideal width 1600px with.

Section Background

Background image. Ideal width 1600px with.

Header Background

Header Background Image. Ideal width 1600px with.

Section Background

Testimonials

3-tag:Testimonials-250px-testimonial

Campus

4-tag:Campus-500px-mosaic

Bài đăng phổ biến

-

Con trỏ chuột trong vùng đồ họa của AutoCAD bao gồm 2 phần: Crosshair và Pickbox. Theo mặc định trong AutoCAD, Crosshair là hai đường th...

-

Thư viện CAD tủ điện cung cấp bản vẽ các thiết bị thông dụng sử dụng trong tủ điện như MCCB, MCB, Contator, Relay... Link download: https:/...

-

Khi vẽ cung tròn, đường tròn, hay đường cong… đối tượng xuất hiện trên vùng đồ họa lại là những đường gấp khúc chứ không phải là những c...

Courses

6-latest-350px-course

LATEST

3-latest-65px